|

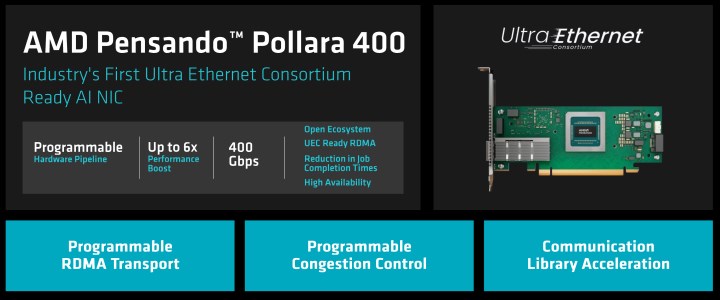

AMD, yapay zeka için Ultra Ethernet'e hazır sektörün ilk ağ kartını tanıttı

-

-

Ağ kartlarına yapay zeka yetenekleri entegre etmenin temel amacının performans artışı olduğuna inanmak zor.

Monitörden, ağ kartlarına her donanımın içine yapay zeka çipleri doldurmalarının sebebi her verinin, görüntünün ölçeklenebilir şekilde analiz edilmesi, fişlenmesi, gerektiğinde duraklatılması.

Yakın gelecekte Snowden, Assange gibi birileri çıkıp insanlık adına kamuoyuyla bazı ifşaatları paylaşmak istediklerinde bunlar daha ethernet kartından geçerken analiz edilip bloklanacak ve ilgili birimler bu kişileri ortadan kaldıracak.

Bu söylediklerimin kimilerine komplo teorisi gibi geldiğini biliyorum. Yapacak bir şey yok, herkes belli bir farkındalığa ulaşana kadar ve özgürlüklerini artık tamamen feda edip duvara çarpana kadar erken öten horoz veya deli diye anılacağız.

-

Fiberoptik kabloyu direk entegre etselerdi :) . Hız zaten AMD in çölde kum tane gibi ufacık kalıyor 400Gbps ... Elbette kendi içinde anlamı vardır.

-

Öyle olsa bile ağ kartlarında yapay zeka kullanılması gecikme özellikle mikrogecikmeler üzerinde büyük fark yaratacaktır.2 seçenek sunmaları Yeter yüksek verim için optimize et düşük gecikme için optimize et.Ve bunlar diğer rotalar üzerinde kullanılan ağ ekipmanları iletişim kurarak en iyi verimi ayarlayacaktır.Artık kullanıcıların manual ayarlamasına gerek yok.

< Bu ileti mobil sürüm kullanılarak atıldı > -

NVIDIA Mellanox ürünlerinden pazar payı almak için GPU tarafında da ezmeleri lazım yoksa beyhude uğraşıyorlar.

-

Bu kartlar yapay zeka sunucuları için özel; benzer kart NVIDIA tarafında da mevcut halihazırda. Burada ben şahsen Nvidia bir AI sistem kurduysam Nvidia Ağ kartı ve Nvidia Switch kullanırım. AMD'de sanırım bu konularda atılım yapacak ve şimdiden sistemini buna hazırlıyor.

Nvidia Spectrum SN5600 switch 800Gbit'lik portlara sahip. Nvidia BluField-3 ağ kartları 400Gbit destekliyor. Nvidia Blackwell çiplere sahip sunucuları aynı markanın ağ ekipmanları ile konuşturmak daha mantıklı olacaktır. Özellikle Nvidia kendi AI sunucusu Blackwell DGX B200 ( 8 adet Blackwell çip içeriyor bu sunucu) 515.000$ dolar civarında bir fiyatla açıklandı. Bunlardan binlercesi verimerkezinde olacaktır.

-

Ya 400Gb/s tamam da. Satın alırlarken Xilinx'in hızlandırıcılı FPGA'larında çift 100 Gb/s vardı zaten. Nasıl bir pazarlama açlığıdır bu.

Bu arada en son bir buçuk sene önce 802.3'e bakmıştım. 1,6 Tb/s taslak, geliştirme aşamasında idi. Onu halledip geçmişler midir 3,2 Tb/s'ye acaba... :)

< Bu mesaj bu kişi tarafından değiştirildi cafyon -- 14 Ekim 2024; 23:55:28 > -

Ya yapay zeka ürünün pazarlama stratejisi. Burada kilit özellik RDMA. Standartlaştırılma yolunda.

Bu mesaj IP'si ile atılan mesajları ara Bu kullanıcının son IP'si ile atılan mesajları ara Bu mesaj IP'si ile kullanıcı ara Bu kullanıcının son IP'si ile kullanıcı ara

KAPAT X

Yeni Kayıt

Yeni Kayıt

Konudaki Resimler

Konudaki Resimler

kullanıcısına yanıt

kullanıcısına yanıt

Hızlı

Hızlı