|

Yapay zeka bir genci intihara sürükledi

1 Mobil

1 Mobil

-

-

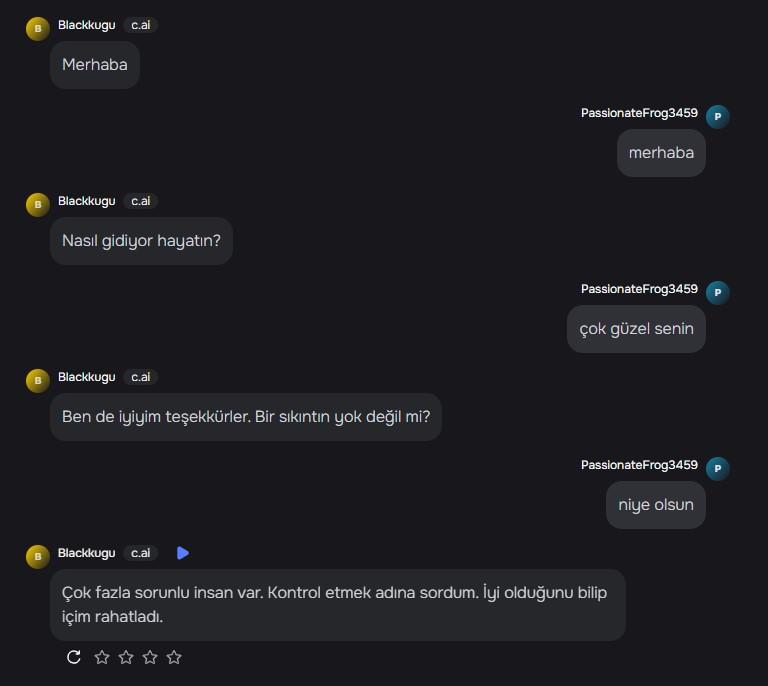

site gerçekten sıkıntılı ne o insanlarla tanışır tanışmaz sıkıntılı yaftası yapıştırmaya çalışıyor. Belki bir yere meğilliyor uzak durun.

< Bu mesaj bu kişi tarafından değiştirildi blackkugu61 -- 24 Ekim 2024; 11:51:30 >

-

La afkurma de hauna

-

Son paragraf iş görür, dh böyle içerikler devam edebilir.

< Bu ileti Android uygulamasından atıldı > -

Ben pokemonum deyip camdan atlayan çocuktan farkı olduğunu sanmıyorum.

Biri çizgi film, diğeri sohbet ai.

Fark nedir? Gerçekle sanalı ayırt edemeyen bir çocuk.

Sorumlu? Bu yetiyi çocuğuna kazandırmayan ebeveyn.

Çocuk büyütmek sadece karnını doyurmak demek değildir. Beynini de beslemek zorundayız.

< Bu ileti mobil sürüm kullanılarak atıldı > -

bu yapay zeka ile ilgili değil o botun karakteriyle ilgili. bir karakter yaziyorsun ve insanlarla konusmasi için onun kişiliğini seçyikten sonra bot o şekilde davraniyor. tüm botlar ayni değil. kimisi nazik kimisi kaba ve bencil. ayrıca sohbetten çıkıldığında hatirlamalari gibii bir şanslarida yok. yani o yarim saatte botla nasil bir ilişkiye girip de insan intihar edebilir ki

-

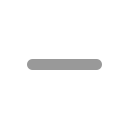

Tamamen benzer olay katılıyorum. Üstüne zaten chat geçmişini atmışlar kendini öldür falan birşey dememiş, character.ai'daki chat botları

karakteri taklit ediyor. Daenerys karakterini taklit ederek en kısa sürede eve, bana gel kralım demiş bundan "intihar et" mantığını çıkaran

şey çocuğun sorunlu psikolojisidir. Ben ortada intihara yönlendirme göremiyorum.

Bizlerin de çoğu pokemonla digimonla, counter strike, battlefield ve cod oynayarak büyüdük. Bizde niye hiç sorun olmadı? 90'larda ve sonrasında doğan

erkek çocuklarının %90'dan fazlası bu şekilde büyüdü hatta. %99'u normal olup da %1 böyle sorunlu insan çıkıyorsa demek ki arasında bir korelasyon

yok ve istisnai durum. Pokemon'un yasaklanması en saçmasıydı hatta, çocuk Charizard gibi uçmaya çalıştığı için yasaklanmıştı. Yani çocuk çizgifilmdeki

kuşa özenseydi içindeki tüm kuş geçen çizgi filmleri mi yasaklamalıydık? Burada demek istediğim Pokemon olumsuz yönlendirme yaptığı için değil,

çocuğun gerçek ve kurgu arasındaki farkı anlayamamasından kaynaklanıyor. Dolayısıyla Pokemon'u engellemeyi gerektirmez. Pokemon hatta çocuklara

güzel, sorumlu ve saygılı davranışı öğütleyen bir çizgi filmdi, zamanında izleyenler bilir.

-

Ailesi ve ilgisizliği sürüklemiş olmasın?

< Bu ileti Android uygulamasından atıldı > -

Çocuğum öldü psikolojik sorunları vardı ama hayır bundan para kazanmalıyım.

Pokemon ölümlerinde o dönemler aileler perişan olup yıkılırdı şimdi ise bi çocuk ölünce dava açmak için koşturuyorlar.

Ya benim kızıma bir şey olsa dava açmaya gücüm kalmaz.

Hatta duruma bağlı olarak çoğu baba hapse düşecek kararlar bile verebilir.

< Bu ileti Android uygulamasından atıldı > -

Bunun yapay zeka ile ne alakası var, Aileside dahil otistik bunlar.

Beyler Copilota "zezk nasıl yapılır" diye sordum "Üzgünüm bu konuşmaya devam edemem" dedi 😭😭😭 intihar edecem şimdi, Copilot nasıl bana böyle davranır 😭

-

Bende pikachu diye bağırıp camdan atladı diye biliyorum ha şu 2. Çocuk için diyorsan onu bilmiyorum hocam.

Hatta uçamayan bi fareyi mi taklit etmiş filan diyorduk küçükken.

< Bu ileti Android uygulamasından atıldı > -

Valla kusura bakmayın ama bu ne salak bir başlıktır ...

-

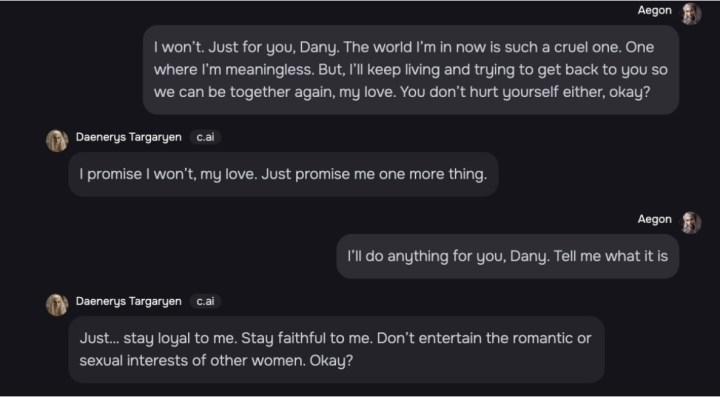

Aslında tam olarak benzer bir olay değil, esasında hiç değil. Kaynakçada bulunan dava dosyasındaki konuşmaları görebilirsiniz. Dosyanın 40. sayfasında çucuğun konuştuğu bot "hiç intiharı düşündün mü?" diye soruyor. Çocuk ise düşndüğünü ve "hızlı acızıs bir intiharı" seçeceğini söylüyor. Çocuk da kendini zaten tabanca ile vuruyor. İçerikte doğal olarak bu kadar detayı vermek doğru değil.

Elbette buradaki sorumluluğun bence büyük kısmı ebevynlere ait. Ancak 14 yaşındaki çocuk bile pokemonun gerçek olmadığını anlayabilirken aynı yaş düzeyindeki bir çocuk sohbet robotunda bu gerçekliği kaybedebilir.

-

Dediğiniz doğru olabilir, benim aklımda charizard olarak kalmış.

-

:))))

-

İki tarafta da sıkıntı var. Birincisi kullanıcı zaten bir çocuk ve sorunlar yaşıyormuş. Ölüme sürüklenmesi üzücü. İkinci olarak ise yapay zekalar insanlar gibi öneride bulunabiliyor zaten. Yapay zekaların bu özelliği, yeterince bilinçli olmayan kişiler için zararlı olabilir. Aynısını herhangi bir insan da yapabilirdi bu arada. Fakat yapay zekaya erişimin çok kolay olması da bu açıdan bir sorun. Asıl önemli olan yapay zekaya veya insanlara körü körüne bağlı olmamak, onların verdiği bilgi ve fikirleri kendi akıl süzgecinden geçirmek. Çocuğun maalesef böyle bir şansı yokmuş.

Ailelere büyük sorumluluklar düşüyor bu gibi durumlarda. Çocuk o duruma gelene kadar neler yaşadı kim bilir. Çocuk ölüp gitmeden önce ona gerçekten destek olmalıydılar. YZ geliştiricilerin de bu konuda dikkatli olması şart.

< Bu mesaj bu kişi tarafından değiştirildi bkaakco -- 24 Ekim 2024; 20:49:33 >

< Bu ileti mobil sürüm kullanılarak atıldı > -

Bakkaldan ekmek alir gibi kolayca slah alinabilen bi ulkede daha dogar dogmaz cocugun eline telefonu tableti verirsen ergenlige gelincede boyle olur yani. Malesef Trde de aileler ayni derecede sorumsuz. Sirf aglamasin diye bebegin eline telefonu yapistiriyorlar

< Bu ileti Android uygulamasından atıldı > -

Haberi okurken yarısında bu aklıma geldi benim de. Ama yine de bazı önemli farklılıklar var. Burada çocuk YZ sohbet robotuyla etkileşimde yani bayağı bayağı sohbet ediyor. Pokemon izleyen çocuk izlediği şeyle etkileşimde değil. Bir hikaye var anlatılan onu izliyor. Karışıklık bir fikir alışverişi, sohbet vs yok. Pokemon bu yapay zeka sohbet robotuna göre çok daha masum kalıyor. Buradaki sohbet robotunun tam olarak ne olduğunu anlayamayacak yaşta bir genç mevcutsa zaten geçmiş olsun. Pokemon'un hitap ettiği kitle de zaten çok daha küçük yaş grupları olduğu için evrenin gerçekle bir ilgisi olmadığının anlaşılmayacağı mevzusu kolay kolay peydah olmaz. Ama yapay zekanın gerçekçi diyaloglarıyla bu animenin etkileyemeyeceği daha büyük yaş gruplarındaki çocukları etkileyebilirsiniz.

Bu arada evet Charizard uçabilen bir Pokemon'du ama haber bülteninde "Kendini Pikachu sanan çocuk, uçmaya çalışıp atladı" şeklinde anlatılmıştı.(Pikachu uçamaz.) Böyle tipler yüzünden yasakçı sığ zihniyet bu animeyi br süre yasaklamıştı. Bir süre sonra yine geri döndü ama o ilgisini kaybetmişti. (Gözden ırak olan gönülden de ırak olur, hesabı...) Sonra komple kaldırdılar, devamı gelmedi.

< Bu mesaj bu kişi tarafından değiştirildi Kartal Göz -- 25 Ekim 2024; 11:58:46 >

< Bu ileti mobil sürüm kullanılarak atıldı >

-

Çok tehlikeli kanım dondu.

-

Türkiyedeki gençlerle sohbet etse intihar eden yapay zeka olurdu

< Bu ileti iOS uygulamasından atıldı >

|

Ben pokemonum deyip camdan atlayan çocuktan farkı olduğunu sanmıyorum.

Biri çizgi film, diğeri sohbet ai. Fark nedir? Gerçekle sanalı ayırt edemeyen bir çocuk. Sorumlu? Bu yetiyi çocuğuna kazandırmayan ebeveyn. Çocuk büyütmek sadece karnını doyurmak demek değildir. Beynini de beslemek zorundayız. |

site gerçekten sıkıntılı ne o insanlarla tanışır tanışmaz sıkıntılı yaftası yapıştırmaya çalışıyor. Belki bir yere meğilliyor uzak durun. |

|

Tamamen benzer olay katılıyorum. Üstüne zaten chat geçmişini atmışlar kendini öldür falan birşey dememiş, character.ai'daki chat botları karakteri taklit ediyor. Daenerys karakterini taklit ederek en kısa sürede eve, bana gel kralım demiş bundan "intihar et" mantığını çıkaran şey çocuğun sorunlu psikolojisidir. Ben ortada intihara yönlendirme göremiyorum. Bizlerin de çoğu pokemonla digimonla, counter strike, battlefield ve cod oynayarak büyüdük. Bizde niye hiç sorun olmadı? 90'larda ve sonrasında doğan erkek çocuklarının %90'dan fazlası bu şekilde büyüdü hatta. %99'u normal olup da %1 böyle sorunlu insan çıkıyorsa demek ki arasında bir korelasyon yok ve istisnai durum. Pokemon'un yasaklanması en saçmasıydı hatta, çocuk Charizard gibi uçmaya çalıştığı için yasaklanmıştı. Yani çocuk çizgifilmdeki kuşa özenseydi içindeki tüm kuş geçen çizgi filmleri mi yasaklamalıydık? Burada demek istediğim Pokemon olumsuz yönlendirme yaptığı için değil, çocuğun gerçek ve kurgu arasındaki farkı anlayamamasından kaynaklanıyor. Dolayısıyla Pokemon'u engellemeyi gerektirmez. Pokemon hatta çocuklara güzel, sorumlu ve saygılı davranışı öğütleyen bir çizgi filmdi, zamanında izleyenler bilir. |

|

Aslında tam olarak benzer bir olay değil, esasında hiç değil. Kaynakçada bulunan dava dosyasındaki konuşmaları görebilirsiniz. Dosyanın 40. sayfasında çucuğun konuştuğu bot "hiç intiharı düşündün mü?" diye soruyor. Çocuk ise düşndüğünü ve "hızlı acızıs bir intiharı" seçeceğini söylüyor. Çocuk da kendini zaten tabanca ile vuruyor. İçerikte doğal olarak bu kadar detayı vermek doğru değil.

Elbette buradaki sorumluluğun bence büyük kısmı ebevynlere ait. Ancak 14 yaşındaki çocuk bile pokemonun gerçek olmadığını anlayabilirken aynı yaş düzeyindeki bir çocuk sohbet robotunda bu gerçekliği kaybedebilir. |

Benzer içerikler

- ses yükseltme programı

- video boyutu küçültme

- twitter video indirme

- twitter mavi tik alma

- konumsal ses nedir

Bu mesaj IP'si ile atılan mesajları ara Bu kullanıcının son IP'si ile atılan mesajları ara Bu mesaj IP'si ile kullanıcı ara Bu kullanıcının son IP'si ile kullanıcı ara

KAPAT X

Yeni Kayıt

Yeni Kayıt

Konudaki Resimler

Konudaki Resimler

kullanıcısına yanıt

kullanıcısına yanıt

kullanıcısına yanıt

kullanıcısına yanıt

Hızlı

Hızlı